A arquitetura shuffle em fibra óptica vem se firmando como uma das principais estratégias para ampliar largura de banda e otimizar o balanceamento de carga em data centers, especialmente nas chamadas fábricas de inteligência artificial. A tecnologia surge como alternativa para contornar limites de portas por switch nas arquiteturas Ethernet tradicionais, ao mesmo tempo em que reduz congestionamentos e aumenta a confiabilidade das redes.

Data centers dedicados à IA disputam ganhos constantes de desempenho, velocidade e eficiência. Embora a adoção mais intensa ocorra em ambientes hyperscale, as inovações já começam a chegar a estruturas neocloud, corporativas, multiusuárias e centrais de telecomunicações, incluindo aplicações de borda, onde serviços de IA com baixa latência se tornam cada vez mais frequentes.

O desafio central está no aumento da demanda por largura de banda, impulsionada por fluxos de dados de grande volume e longa duração, conhecidos como Elephant Flows. Esse tráfego pode sobrecarregar buffers de switches, provocar perda de pacotes, atrasos no processamento e bloqueio de comunicações mais sensíveis. Em redes de IA, a necessidade de retransmissão de pacotes amplia o consumo de energia por tarefa processada e gera novos atrasos, cenário considerado crítico para operações de alto desempenho.

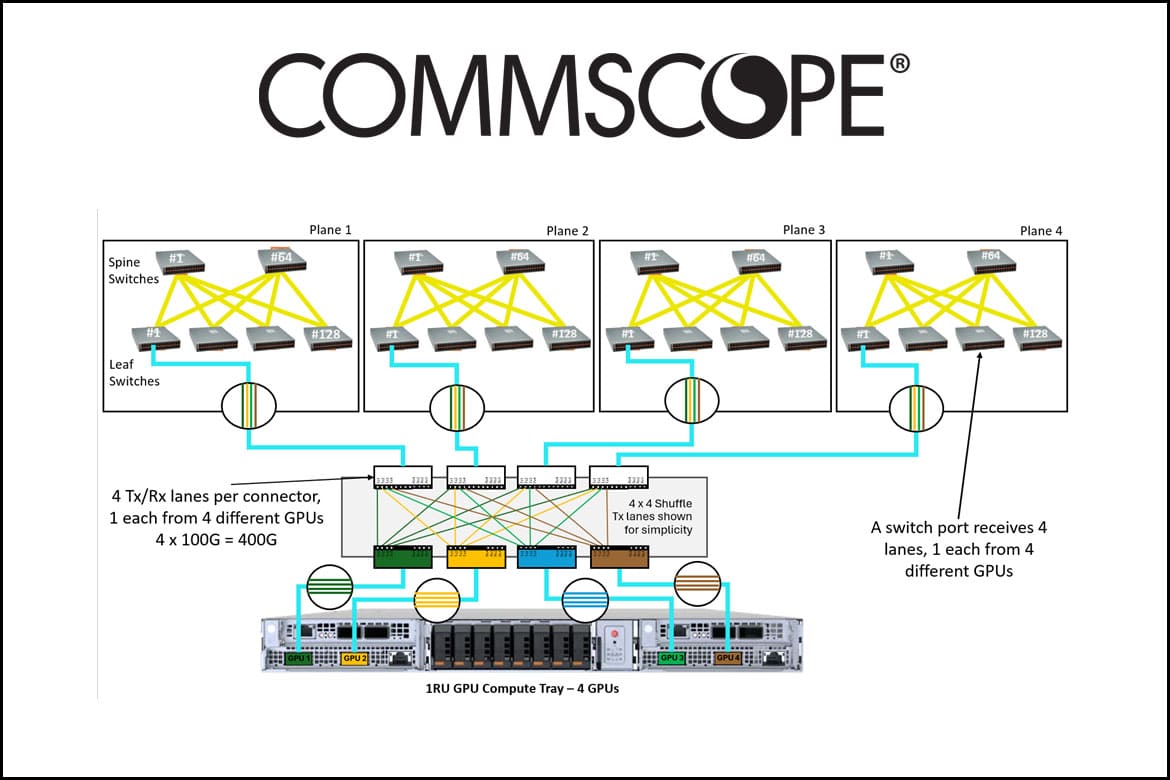

A arquitetura shuffle propõe uma reorganização das conexões ópticas para distribuir o tráfego de forma mais equilibrada entre múltiplos caminhos físicos e diferentes planos de comutação. Em vez de concentrar todas as lanes ópticas de uma única porta de GPU em uma única porta de switch, como ocorre no modelo tradicional leaf and spine, o sistema redistribui essas lanes entre vários switches e planos distintos.

Com isso, cada porta de switch na camada leaf deixa de estar dedicada exclusivamente a uma única GPU. A mudança permite a criação de clusters com maior número de GPUs utilizando apenas dois níveis de comutação, evitando a necessidade de migrar para um modelo de três camadas. O resultado são redes mais planas e com menor penalidade de latência.

A redistribuição das lanes ópticas também viabiliza multipercursos reais entre GPUs, favorecendo melhor balanceamento de carga. O tráfego pode ser espalhado por diferentes planos e portas, sustentando maior volume contínuo de dados sem depender de um único canal de fibra ou porta de switch. Em caso de falha de um switch ou porta, a maior parte da carga é redirecionada automaticamente para outros caminhos físicos, mantendo a rede ativa, ainda que com redução parcial de desempenho nos pontos afetados.

A implementação da arquitetura shuffle pode ocorrer por meio de módulos, painéis ou cabos específicos, conforme as exigências do projeto de rede. A escolha depende da topologia adotada e das necessidades de escalabilidade do ambiente de IA.

Impulsionada por aplicações intensivas de inteligência artificial, a arquitetura shuffle desponta como solução para elevar a densidade e a eficiência das redes em data centers de diferentes perfis, acompanhando a expansão acelerada das cargas de trabalho baseadas em GPUs.

Site relacionado: https://www.commscope.com

Fonte: Alastair Waite

Acompanhe a Panorama Audiovisual no Facebook e YouTube